目次

RealSenseとYOLOを用いた物体認識概要

今回はRealSenseセンサとYOLO7を用いて物体認識をすることにTryしてみる。

- 物体認識:YOLO7

- 三次元データ取得:RealSense D435

- GPU:GTX2080Super

- CPU:Intel(R) Core(TM) i7-9700F

- *備考:RealSense D435はUSB3.0のポートに繋いでおこう。さもないと、デバイスが認識されないかも。

を利用した。

当然ながら、コードの大きな構成はRealSenseで3次元データ取得する部分と物体認識部分に大別される。

RealSenseで3次元データを取得する方法は以下のリンクを参照していただければと思う。

RealSenseセンサー(立ち上げ編)

YOLO7を用いて物体認識を処理する部分(下に抜粋コードを記載)を簡単に解説すると、

YOLO7での物体認識フロー

- Model(Pred.)にて入力画像imgに対してモデルを適用し、認識(Detection)を行う

*今回は予測にかかった時間を計算するためにtime_synchronized()を使用している。 - non_max_suppresion()で非最大抑制という手法を使用して、予測結果を最適化します。NMSは重複した予測を削除するために使用されます。

- 検出結果が存在するときに、

det[:, :4] = scale_coords(img.shape[2:], det[:, :4], im0.shape).round():ここで、検出された物体のバウンディングボックス(矩形領域)を、元の画像のサイズにリスケール(スケール変換)しています for *xyxy, conf, cls in reversed(det)::ここで、各検出結果に対してループを行い、そのバウンディングボックスの座標(xyxy)、信頼度(conf)、クラス(cls)を取得しています。plot_one_box(xyxy, im0, label=label, color=colors[int(cls)], line_thickness=2):ここで、バウンディングボックスを画像に描画しています。ラベル(クラス名と信頼度)と色も指定しています。cv2.imshow("Recognition result", im0):ここで、処理結果の画像を表示しています

機械学習で本質的な部分はModel関数の部分であり、それ以外はその結果をどう扱うかである。

# Inference

t1 = time_synchronized()

with torch.no_grad(): # Calculating gradients would cause a GPU memory leak

pred = model(img, augment=opt.augment)[0]

t2 = time_synchronized()

times.append(t2 - t1)

times = times[-20:]

# Apply NMS

pred = non_max_suppression(pred, opt.conf_thres, opt.iou_thres, classes=opt.classes, agnostic=opt.agnostic_nms)

t3 = time_synchronized()

times2.append(t3 - t2)

times2 = times2[-20:]

# Process detections

for i, det in enumerate(pred): # detections per image

gn = torch.tensor(im0.shape)[[1, 0, 1, 0]] # normalization gain whwh

if len(det):

# Rescale boxes from img_size to im0 size

det[:, :4] = scale_coords(img.shape[2:], det[:, :4], im0.shape).round()

# Print results

for c in det[:, -1].unique():

n = (det[:, -1] == c).sum() # detections per class

#s += f"{n} {names[int(c)]}{'s' * (n > 1)}, " # add to string

# Write results

for *xyxy, conf, cls in reversed(det):

c = int(cls) # integer class

label = f'{names[c]} {conf:.2f}'

plot_one_box(xyxy, im0, label=label, color=colors[int(cls)], line_thickness=2)

plot_one_box(xyxy, depth_colormap, label=label, color=colors[int(cls)], line_thickness=2)

# Print time (inference + NMS)

#print(f'{s}Done. ({(1E3 * (t2 - t1)):.1f}ms) Inference, ({(1E3 * (t3 - t2)):.1f}ms) NMS')

im0 = cv2.putText(im0, "Time: {:.2f}ms".format(sum(times) / len(times) * 1000)+" Inference: {:.2f}ms".format(sum(times2) / len(times2) * 1000), (0, 30),

cv2.FONT_HERSHEY_COMPLEX_SMALL, 1, (0, 0, 255), 2)

# Stream results

cv2.imshow("Recognition result", im0)

cv2.imshow("Recognition result depth",depth_colormap)

if cv2.waitKey(1) & 0xFF == ord('q'):

break実行結果(GPU vs CPU)

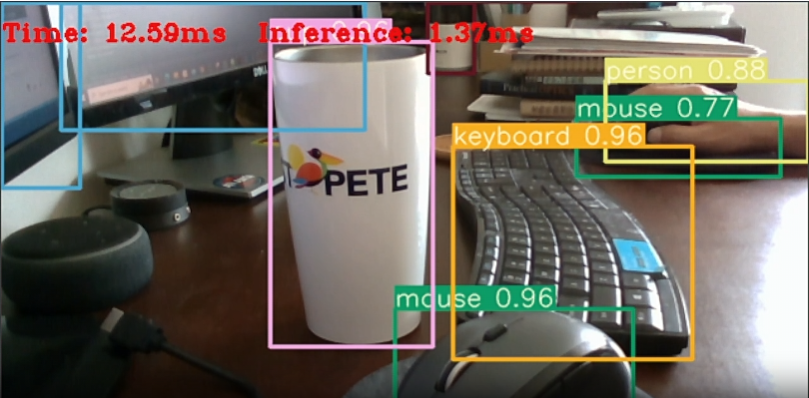

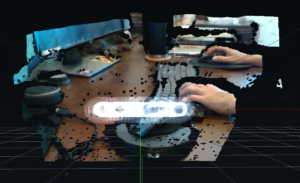

下に記載したソースコードを実際にRealSenseを用いて実行した結果が以下になる。

今回はGPUを用いた時とCPUを用いた時の差を見てみよう。

まずGPUでの認識実行結果は以下になる。

次にCPUでの認識実行結果は以下になる。

- テレビ1/2台、コップ1つ、人間1人、マウス2つ、キーボード1つ、本数冊を認識している

- 物体の推定時間(Inference)は、1ms程度であり、この部分はGPUと変わらない。

- NMSの適用にかかった時間は、500ms程度でGPUと比較して50倍も時間がかかっている。

このように見てみるとだいぶ両者には違いがあるものの、推論の部分は両者同じ時間だけかかっている。一方でNMSの部分でGPUの効果が出ており、50倍短縮しているのがわかる。

ソースコード

import argparse

import time

from pathlib import Path

import cv2

import torch

import torch.backends.cudnn as cudnn

from numpy import random

from yolov7.models.experimental import attempt_load

#from utils.datasets import LoadStreams, LoadImages

from yolov7.utils.general import check_img_size, check_requirements, check_imshow, non_max_suppression, apply_classifier, \

scale_coords, xyxy2xywh, strip_optimizer, set_logging, increment_path

from yolov7.utils.plots import plot_one_box

from yolov7.utils.torch_utils import select_device, load_classifier, time_synchronized, TracedModel

import pyrealsense2 as rs

import numpy as np

def detect(save_img=False):

source, weights, view_img, save_txt, imgsz, trace = opt.source, opt.weights, opt.view_img, opt.save_txt, opt.img_size, not opt.no_trace

# Directories

save_dir = Path(increment_path(Path(opt.project) / opt.name, exist_ok=opt.exist_ok)) # increment run

(save_dir / 'labels' if save_txt else save_dir).mkdir(parents=True, exist_ok=True) # make dir

# Initialize

set_logging()

device = select_device(opt.device)

print("device: ", device.type)

half = device.type != 'cpu' # half precision only supported on CUDA

# Load model

model = attempt_load(weights, map_location=device) # load FP32 model

stride = int(model.stride.max()) # model stride

imgsz = check_img_size(imgsz, s=stride) # check img_size

if trace:

model = TracedModel(model, device, opt.img_size)

if half:

model.half() # to FP16

# Second-stage classifier

classify = False

if classify:

modelc = load_classifier(name='resnet101', n=2) # initialize

modelc.load_state_dict(torch.load('weights/resnet101.pt', map_location=device)['model']).to(device).eval()

# Get names and colors

names = model.module.names if hasattr(model, 'module') else model.names

colors = [[random.randint(0, 255) for _ in range(3)] for _ in names]

# Run inference

if device.type != 'cpu':

model(torch.zeros(1, 3, imgsz, imgsz).to(device).type_as(next(model.parameters()))) # run once

old_img_w = old_img_h = imgsz

old_img_b = 1

config = rs.config()

config.enable_stream(rs.stream.color, 640, 480, rs.format.bgr8, 30)

config.enable_stream(rs.stream.depth, 640, 480, rs.format.z16, 30)

pipeline = rs.pipeline()

profile = pipeline.start(config)

align_to = rs.stream.color

align = rs.align(align_to)

times = []

times2 = []

while(True):

#t0 = time.time()

frames = pipeline.wait_for_frames()

aligned_frames = align.process(frames)

color_frame = aligned_frames.get_color_frame()

depth_frame = aligned_frames.get_depth_frame()

if not depth_frame or not color_frame:

continue

img = np.asanyarray(color_frame.get_data())

depth_image = np.asanyarray(depth_frame.get_data())

depth_colormap = cv2.applyColorMap(cv2.convertScaleAbs(depth_image, alpha=0.08), cv2.COLORMAP_JET)

# Letterbox

im0 = img.copy()

img = img[np.newaxis, :, :, :]

# Stack

img = np.stack(img, 0)

# Convert

img = img[..., ::-1].transpose((0, 3, 1, 2)) # BGR to RGB, BHWC to BCHW

img = np.ascontiguousarray(img)

img = torch.from_numpy(img).to(device)

img = img.half() if half else img.float() # uint8 to fp16/32

img /= 255.0 # 0 - 255 to 0.0 - 1.0

if img.ndimension() == 3:

img = img.unsqueeze(0)

# Warmup

if device.type != 'cpu' and (old_img_b != img.shape[0] or old_img_h != img.shape[2] or old_img_w != img.shape[3]):

old_img_b = img.shape[0]

old_img_h = img.shape[2]

old_img_w = img.shape[3]

for i in range(3):

model(img, augment=opt.augment)[0]

# Inference

t1 = time_synchronized()

with torch.no_grad(): # Calculating gradients would cause a GPU memory leak

pred = model(img, augment=opt.augment)[0]

t2 = time_synchronized()

times.append(t2 - t1)

times = times[-20:]

# Apply NMS

pred = non_max_suppression(pred, opt.conf_thres, opt.iou_thres, classes=opt.classes, agnostic=opt.agnostic_nms)

t3 = time_synchronized()

times2.append(t3 - t2)

times2 = times2[-20:]

# Process detections

for i, det in enumerate(pred): # detections per image

gn = torch.tensor(im0.shape)[[1, 0, 1, 0]] # normalization gain whwh

if len(det):

# Rescale boxes from img_size to im0 size

det[:, :4] = scale_coords(img.shape[2:], det[:, :4], im0.shape).round()

# Print results

for c in det[:, -1].unique():

n = (det[:, -1] == c).sum() # detections per class

#s += f"{n} {names[int(c)]}{'s' * (n > 1)}, " # add to string

# Write results

for *xyxy, conf, cls in reversed(det):

c = int(cls) # integer class

label = f'{names[c]} {conf:.2f}'

plot_one_box(xyxy, im0, label=label, color=colors[int(cls)], line_thickness=2)

plot_one_box(xyxy, depth_colormap, label=label, color=colors[int(cls)], line_thickness=2)

# Print time (inference + NMS)

#print(f'{s}Done. ({(1E3 * (t2 - t1)):.1f}ms) Inference, ({(1E3 * (t3 - t2)):.1f}ms) NMS')

im0 = cv2.putText(im0, "Time: {:.2f}ms".format(sum(times) / len(times) * 1000)+" Inference: {:.2f}ms".format(sum(times2) / len(times2) * 1000), (0, 30),

cv2.FONT_HERSHEY_COMPLEX_SMALL, 1, (0, 0, 255), 2)

# Stream results

cv2.imshow("Recognition result", im0)

cv2.imshow("Recognition result depth",depth_colormap)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

if __name__ == '__main__':

parser = argparse.ArgumentParser()

parser.add_argument('--weights', nargs='+', type=str, default='yolov7.pt', help='model.pt path(s) yolov7-tiny.pt')

parser.add_argument('--source', type=str, default='inference/images', help='source') # file/folder, 0 for webcam

parser.add_argument('--img-size', type=int, default=640, help='inference size (pixels)')

parser.add_argument('--conf-thres', type=float, default=0.35, help='object confidence threshold')

parser.add_argument('--iou-thres', type=float, default=0.45, help='IOU threshold for NMS')

parser.add_argument('--device', default='', help='cuda device, i.e. 0 or 0,1,2,3 or cpu')

parser.add_argument('--view-img', action='store_true', help='display results')

parser.add_argument('--save-txt', action='store_true', help='save results to *.txt')

parser.add_argument('--save-conf', action='store_true', help='save confidences in --save-txt labels')

parser.add_argument('--nosave', action='store_true', help='do not save images/videos')

parser.add_argument('--classes', nargs='+', type=int, help='filter by class: --class 0, or --class 0 2 3')

parser.add_argument('--agnostic-nms', action='store_true', help='class-agnostic NMS')

parser.add_argument('--augment', action='store_true', help='augmented inference')

parser.add_argument('--update', action='store_true', help='update all models')

parser.add_argument('--project', default='runs/detect', help='save results to project/name')

parser.add_argument('--name', default='exp', help='save results to project/name')

parser.add_argument('--exist-ok', action='store_true', help='existing project/name ok, do not increment')

parser.add_argument('--no-trace', action='store_true', help='don`t trace model')

opt = parser.parse_args()

print("opt:", opt)

#check_requirements(exclude=('pycocotools', 'thop'))

with torch.no_grad():

if opt.update: # update all models (to fix SourceChangeWarning)

for opt.weights in ['yolov7.pt']:

detect()

strip_optimizer(opt.weights)

else:

detect()

コメント